LLMエージェントの「ハーネス」革命:自動合成・自然言語化・長期実行設計が切り拓く次世代AIエージェント工学

コードとして自動合成されるハーネス、自然言語で記述される実行可能なエージェント制御層、そして長期自律コーディングを支える多エージェント設計——3つの最前線研究が示す「ハーネス工学」の全貌と、LLMエージェントの性能を根本から変える設計思想を深く解説する。

なぜ今「ハーネス」が重要なのか

LLM(大規模言語モデル)の能力は急速に向上しているが、エージェントとして実環境に展開したとき、モデルの「賢さ」だけでは解決できない問題が浮き彫りになってきた。その最たる例が、Kaggle GameArenaのチェス競技における衝撃的な統計だ。Gemini 2.5 Flashの敗北のうち78%が、戦略的ミスではなく**ルール違反の不正な手(illegal moves)**によるものだったという。モデルはチェスのルールを「知っている」にもかかわらず、実際の行動選択においてそのルールを守れない——この乖離こそが、現在のLLMエージェント研究における中心的な課題である。

この問題を解決するために注目されているのが「ハーネス(harness)」という概念だ。ハーネスとは、LLMと外部環境の間に介在する制御層であり、モデルの出力を検証・フィルタリング・構造化する役割を担う。従来、ハーネスは人間のエンジニアが手作業で設計するものだったが、2026年に入り、この設計プロセス自体をAIが担う研究が相次いで発表された。

本稿では、Google DeepMindによる「AutoHarness」、清華大学らによる「Natural-Language Agent Harnesses(NLAH)」、そしてAnthropicのエンジニアリングブログによる長期実行アプリケーション向けハーネス設計の実践知——この3つのソースを統合し、ハーネス工学の現在地と未来を多角的に論じる。

AutoHarness:LLM自身がハーネスをコードとして合成する

問題の本質:行動適用可能性(Action Applicability)

Google DeepMindの研究チームが提案するAutoHarnessは、ハーネス設計の自動化に正面から取り組む。AIプランニングの文脈では「行動適用可能性(action applicability)問題」として知られるこの課題——ある状態においてどの行動が有効かを正確に判断すること——は、LLMにとって意外なほど困難だ。

従来の対策として、ゲームの軌跡データによるファインチューニングや手動設計のハーネスが用いられてきた。しかしファインチューニングは大規模モデルに対してコスト・時間ともに非現実的であり、手動ハーネスは新しいゲームやタスクごとに再設計が必要で拡張性に乏しい。AutoHarnessはこの問題を、LLM自身のコード生成能力を使ってハーネスを自動合成するという発想で解決する。

コード・アズ・ハーネスの仕組み

AutoHarnessの核心は「code as harness」フレームワークだ。最もシンプルな形では、ハーネスはLLMを呼び出し、不適切な出力を拒否する制御ループとして機能する。この「何が許容されるか」の定義自体を学習するのがポイントであり、本質的にはタスクに応じた条件付き棄却サンプラー(rejection sampler)として機能する。

図1: Code-as-harnessの学習プロセス。複数のコード仮説をツリー構造で管理し、Thompson samplingによって次に洗練すべきノードを選択する。

図1: Code-as-harnessの学習プロセス。複数のコード仮説をツリー構造で管理し、Thompson samplingによって次に洗練すべきノードを選択する。

この図が示すように、AutoHarnessは複数のコード仮説をツリー構造で保持し、Thompson samplingを用いて探索と活用のバランスを取りながら最適なハーネスへと収束させる。各ノードの評価指標は「合法的な行動の割合(legal move accuracy)」であり、環境からのフィードバック(行動が合法か否か、得られた報酬)をもとにLLMがコードを洗練させていく。

具体的には、is_legal_action()とpropose_action()という2つの関数を学習する。is_legal_action()がTrueを返したにもかかわらず行動が無効だった場合は両関数を修正し、is_legal_action()がFalseを返して行動が無効だった場合はpropose_action()のみを修正するという、きめ細かいフィードバック設計が採用されている。

コード・アズ・ポリシーへの発展

AutoHarnessの設計はさらに野心的な方向へ拡張できる。ハーネスの柔軟性を最大化すると、code as policyの形態に到達する——LLMを意思決定時に呼び出すことなく、コード自体が次の行動を直接提案する形式だ。

図2: 6つのゲームにおけるコード洗練回数と合法手の割合の推移。洗練を重ねるごとに合法手の割合が急速に向上する様子が確認できる。

図2: 6つのゲームにおけるコード洗練回数と合法手の割合の推移。洗練を重ねるごとに合法手の割合が急速に向上する様子が確認できる。

実験結果は顕著だ。145種類のTextArenaゲーム(1人用・2人用)において、AutoHarnessはすべての不正行動を排除することに成功した。さらに、生成されたコードポリシーは16の1人用ゲームにおいてGemini-2.5-ProおよびGPT-5.2-Highを上回る平均報酬を達成した。

図3: 16の2人用ゲームにおける本手法とGemini-2.5-Proの勝敗率比較。多くのゲームで小型モデルが大型モデルを凌駕している。

図3: 16の2人用ゲームにおける本手法とGemini-2.5-Proの勝敗率比較。多くのゲームで小型モデルが大型モデルを凌駕している。

この結果が持つ意義は大きい。小型モデル(Gemini-2.5-Flash)が自動合成したハーネスを使うことで、より大型のモデル(Gemini-2.5-Pro)を上回れるという事実は、モデルサイズの競争とは異なる次元での性能向上の道筋を示している。コスト効率の観点からも、大型モデルへの依存を減らせる可能性は産業界にとって極めて重要だ。

Natural-Language Agent Harnesses:ハーネスを「ポータブルな自然言語オブジェクト」として再定義する

ハーネス設計の「見えない問題」

清華大学らが提案する**Natural-Language Agent Harnesses(NLAH)**は、AutoHarnessとは異なる角度からハーネス問題に切り込む。彼らが指摘するのは、現代のエージェントシステムにおけるハーネスの「不可視性」だ。

現状では、エージェントの制御ロジックはコントローラーコード、フレームワークのデフォルト設定、ツールアダプター、検証スクリプト、ランタイム固有の前提条件などに散在している。その結果、ハーネスは異なるランタイム間で移植しにくく、公平な比較が困難で、モジュール単位でのアブレーション(要素除去実験)もままならない。2つのシステムが「1つの設計選択だけ異なる」と主張していても、実際にはプロンプト、ツール仲介、アーティファクト規約、検証ゲート、状態セマンティクスが同時に異なっていることが多い。

この図が示すように、ハーネスには多様な設計パターンが存在するが、これらは通常コードの中に埋め込まれており、科学的な研究対象として比較・分析することが難しい。

NLAHとIHRの設計思想

NLAHの核心的な問いは「エージェントハーネスの高レベル制御ロジックを、ポータブルな実行可能アーティファクトとして外部化できるか」だ。

図2: フレームワーク概要。Intelligent Harness Runtime(IHR)は、インループLLM、ツールアクセスと子エージェントサポートを持つバックエンド、ポリシーとセマンティクスを指定するランタイムチャーターで構成される。

図2: フレームワーク概要。Intelligent Harness Runtime(IHR)は、インループLLM、ツールアクセスと子エージェントサポートを持つバックエンド、ポリシーとセマンティクスを指定するランタイムチャーターで構成される。

NLAHは、ハーネスの振る舞いを編集可能な自然言語で表現する。そして**Intelligent Harness Runtime(IHR)**という共有ランタイムが、明示的なコントラクト、耐久性のあるアーティファクト、軽量アダプターを通じてこれらのハーネスを実行する。

NLAHが実行可能であるために必要な要素として、論文は以下を挙げている:コントラクト(何を生産すべきか、どのゲートを満たすべきか)、ロール(各エージェントの責任境界)、ステージ構造、アダプター、スクリプト、状態セマンティクス、失敗分類体系。これらを自然言語で明示的に記述することで、ハーネスは「コードに埋め込まれた暗黙知」から「科学的に比較・研究できる一級市民オブジェクト」へと昇格する。

「コンテキストエンジニアリング」という新概念

NLAHの論文が提唱するもう一つの重要な概念が「コンテキストエンジニアリング」だ。これは従来の「プロンプトエンジニアリング」を包含・拡張する概念であり、長期実行タスクにおいて各ステップで何の指示・証拠・中間アーティファクト・状態を利用可能にするかを設計する実践を指す。

タスクが複数のコンテキストウィンドウにまたがる場合、堅牢な進捗は一発のプロンプト設計よりも、耐久性のある状態サーフェス、検証ゲート、明確な責任境界に依存する——この洞察はAnthropicの実践知とも深く共鳴する。

Anthropicの実践知:長期実行アプリケーションのためのハーネス設計

失敗モードの解剖学

AnthropicのエンジニアPrithvi Rajasekaranによる実践レポートは、上記2つの学術研究を「現場の血肉」で補完する。彼が取り組んだのは、Claudeに高品質なフロントエンドデザインを生成させること、そして人間の介入なしに完全なアプリケーションを構築させることという2つの課題だ。

長期実行エージェントには2つの典型的な失敗モードがある。第一はコンテキストウィンドウの枯渇による一貫性の喪失。タスクが長くなるにつれてモデルは文脈を失い、作業が脱線する。第二は「コンテキスト不安(context anxiety)」——モデルがコンテキスト上限に近づいていると感じると、作業を早期に打ち切ろうとする現象だ。Claude Sonnet 4.5ではこの傾向が特に顕著で、コンテキストの圧縮(compaction)だけでは不十分だったという。

解決策として採用されたのがコンテキストリセットだ。コンテキストウィンドウを完全にクリアして新しいエージェントを起動し、前のエージェントの状態と次のステップを構造化されたハンドオフアーティファクトで引き継ぐ。圧縮が「同じエージェントが短縮された履歴で継続する」のに対し、リセットは「クリーンスレートを提供する」点で本質的に異なる。

自己評価問題とGAN的解決策

第二の問題は自己評価の信頼性だ。エージェントは自分が生成した成果物を評価するよう求められると、品質が明らかに低くても自信を持って称賛する傾向がある。これは主観的なデザイン品質の評価で特に顕著だが、検証可能なタスクでも判断の甘さは残る。

Rajasekaranが採用した解決策は、GAN(敵対的生成ネットワーク)からインスピレーションを得た多エージェント構造だ。生成エージェントと評価エージェントを分離し、評価エージェントを懐疑的に調整することで、生成エージェントが具体的なフィードバックを反復改善の基盤として使えるようにした。

図: ソロハーネスで作成されたアプリの初期画面。単一エージェントによる生成の限界が見て取れる。

図: ソロハーネスで作成されたアプリの初期画面。単一エージェントによる生成の限界が見て取れる。

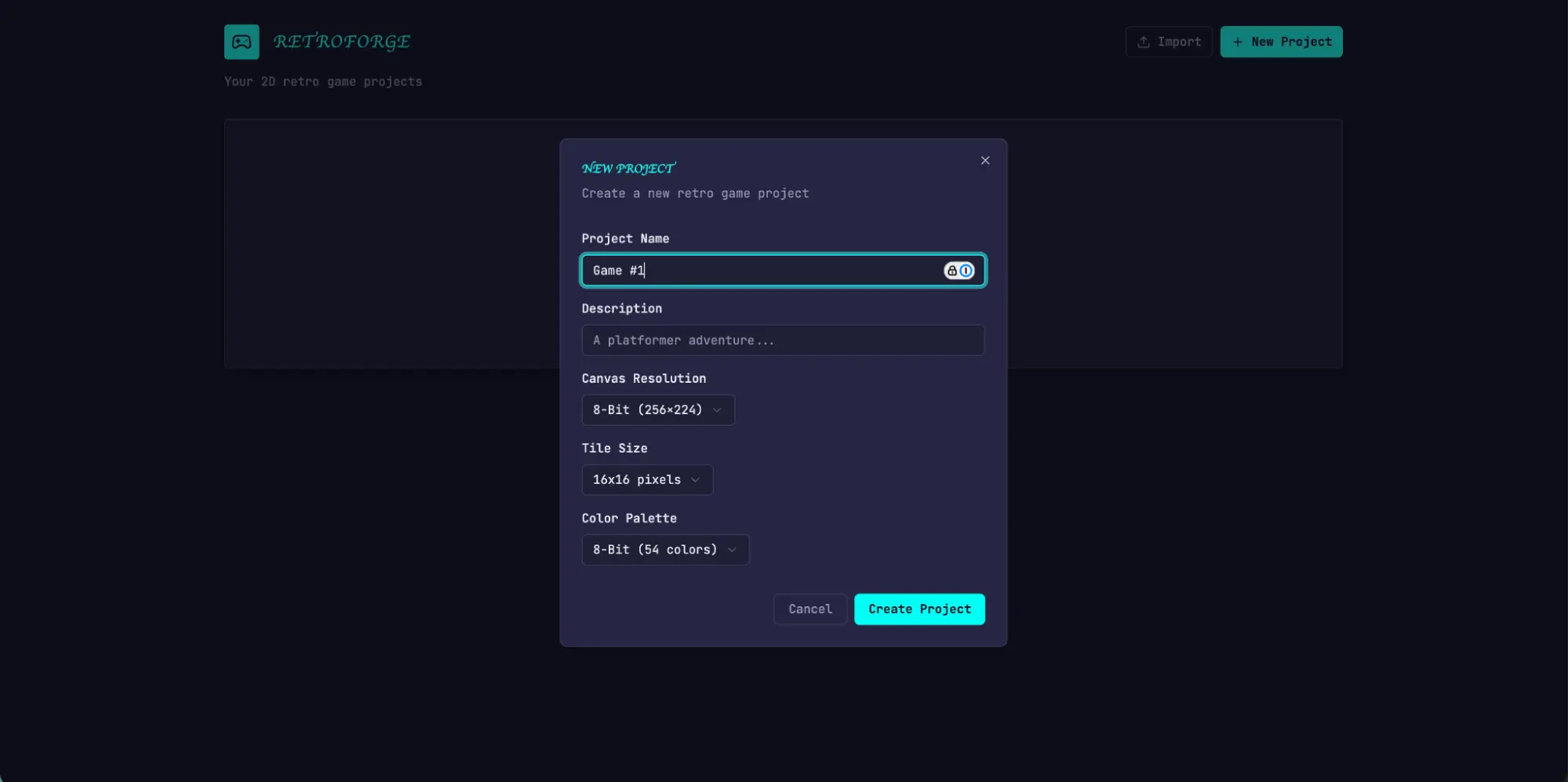

図: フルハーネス(プランナー・ジェネレーター・エバリュエーターの3エージェント構成)で構築されたアプリの初期画面。品質の向上が視覚的に明確だ。

図: フルハーネス(プランナー・ジェネレーター・エバリュエーターの3エージェント構成)で構築されたアプリの初期画面。品質の向上が視覚的に明確だ。

フロントエンドデザインの評価には4つの基準を設定した:デザイン品質(全体的な一貫性)、独自性(テンプレートやAI的パターンからの脱却)、クラフト(技術的実行品質)、機能性(ユーザビリティ)。特にデザイン品質と独自性を重視することで、モデルをより大胆な美的リスクテイクへと誘導した。

最終的に構築されたのはプランナー・ジェネレーター・エバリュエーターの3エージェントアーキテクチャであり、複数時間にわたる自律コーディングセッションでリッチなフルスタックアプリケーションを生成することに成功した。

3つのアプローチの統合的考察:ハーネス工学の設計空間

補完関係と対比

3つのソースは、ハーネス工学の異なる次元を照らし出している。

AutoHarnessは「ハーネスをどう生成するか」という**合成(synthesis)**の問題を解く。LLMのコード生成能力を使って、タスク固有の制御ロジックを自動的に発見する。これは本質的にプログラム合成問題であり、Thompson samplingによるツリー探索が探索効率を担保する。

NLAHは「ハーネスをどう表現・共有するか」という**表現(representation)**の問題を解く。コードではなく自然言語でハーネスを記述することで、移植性・比較可能性・研究可能性を高める。AutoHarnessがコードを生成するのに対し、NLAHはその制御ロジックを自然言語で外部化する——両者は相互補完的だ。

Anthropicの実践知は「ハーネスをどう運用するか」という**実装(implementation)**の問題を解く。コンテキストリセット、多エージェント分離、評価基準の明示化といった具体的な設計パターンは、NLAHが「ハーネス設計パターン」として分類するものの実践的な具体例でもある。

コンテキストエンジニアリングという共通軸

3つのアプローチに共通するのは、「コンテキストエンジニアリング」の重要性の認識だ。NLAHはこれを明示的に概念化し、AutoHarnessは環境フィードバックをコンテキストとして活用し、Anthropicは状態のハンドオフアーティファクトとして具体化する。プロンプトの一発設計から、長期実行にわたる状態・証拠・指示の動的管理へ——この転換がハーネス工学の本質だ。

小型モデルの逆転という示唆

AutoHarnessの最も挑発的な発見は、適切に設計されたハーネスを持つ小型モデルが、ハーネスなしの大型モデルを上回れるという点だ。これはモデルサイズの軍拡競争に対するアンチテーゼであり、エージェントシステムの性能がモデル単体の能力よりもシステム設計に依存することを示唆する。

業界・社会への影響と示唆

エージェントAIの信頼性問題

不正行動の排除は、ゲームの文脈を超えた普遍的な重要性を持つ。医療診断支援、法律文書作成、金融取引など、実世界の高リスク応用においてLLMエージェントが「ルール違反の行動」を取ることは許容されない。AutoHarnessが示す自動ハーネス合成のアプローチは、こうした応用における信頼性保証の基盤技術となりうる。

ハーネスの標準化と再利用

NLAHが提唱する「ポータブルなハーネス表現」は、エージェントシステムの標準化と再利用を促進する可能性がある。現在、各社・各チームが独自にハーネスを設計している状況は、車輪の再発明の連続だ。自然言語で記述された実行可能なハーネスが共有・比較できるようになれば、エージェント工学の知識が蓄積・伝達されやすくなる。

長期自律エージェントの実用化

Anthropicの実践は、数時間にわたる自律的なソフトウェア開発が現実のものとなりつつあることを示す。コンテキストリセット、多エージェント評価、構造化ハンドオフという設計パターンの組み合わせは、今後のAIエンジニアリングの標準的な知識体系に組み込まれていくだろう。

まとめ・今後の展望

ハーネス工学は、LLMエージェント研究における次の主戦場だ。モデルの能力向上だけでは解決できない問題——不正行動、自己評価の甘さ、長期実行における一貫性喪失——に対して、ハーネスの設計が決定的な差をもたらすことが3つのソースを通じて明確になった。

今後の展望として、以下の方向性が考えられる。第一に、AutoHarnessのアプローチをゲーム以外のドメイン(コーディング、科学研究、ビジネスプロセス)へ拡張すること。第二に、NLAHのような標準化された表現形式が普及し、ハーネスのオープンソースエコシステムが形成されること。第三に、Anthropicが示した多エージェントアーキテクチャが、より複雑な長期タスクへと適用範囲を広げること。

「モデルを大きくする」から「システムを賢く設計する」へ——この転換は、AIエージェントの実用化を加速させると同時に、より小型・低コストなモデルでも高性能なシステムを構築できる民主化の可能性を秘めている。ハーネス工学の成熟は、AIの社会実装における次の臨界点となるだろう。